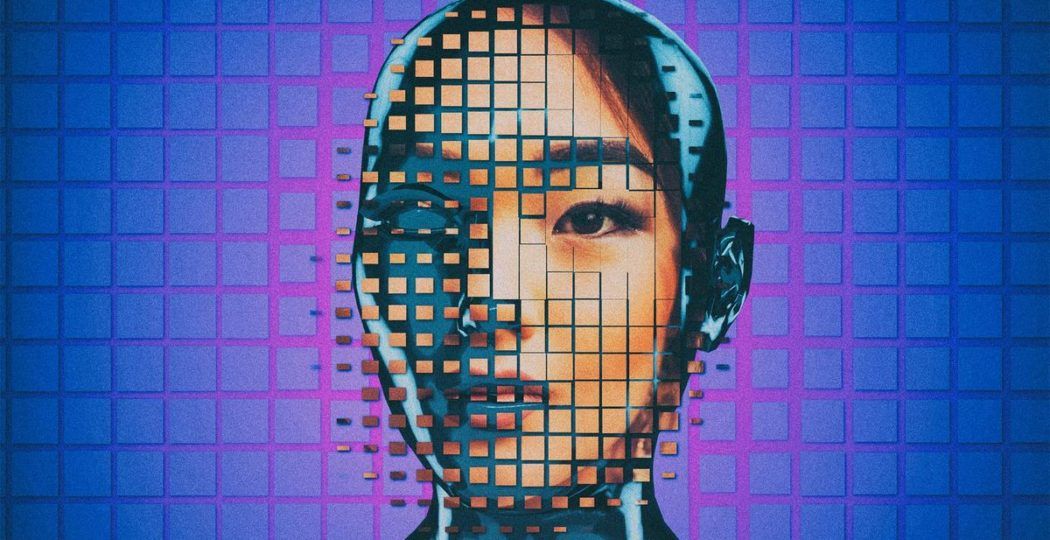

Ακόμα ένας λόγος να μην πιστεύεις στα μάτια σου. Οι δυνατότητες επεξεργασίας βίντεο είναι πλέον σχεδόν απεριόριστες. Δημόσια πρόσωπα μετατρέπονται έτσι σε «ψηφιακές μαριονέτες» που ξεστομίζουν τα πιο απίθανα πράγματα. O Ομπάμα στολίζει τον Τραμπ με επίθετα που μόνο ο τελευταίος θα χρησιμοποιούσε και ο Μαρκ Ζούκεμπεργκ του Facebook δηλώνει με ύφος τζεϊμσμποντικού κακού ότι «όποιος ελέγχει τα δεδομένα, ελέγχει το μέλλον». Πώς να διακρίνει κανείς την αλήθεια από το ψέμα;

Ο Χάο Λι, καθηγητής Πληροφορικής του Πανεπιστημίου της Νότιας Καλιφόρνιας και ειδικός σε θέματα ψηφιακής επεξεργασίας εικόνας, υποστηρίζει ότι σε έξι μήνες με έναν χρόνο από σήμερα η τεχνολογία που επιτρέπει την παραγωγή «πλαστών βίντεο» θα είναι τόσο εξελιγμένη και θα παράγει τόσο ρεαλιστικά αποτελέσματα ώστε κανένας να μην είναι πια σε θέση να εντοπίσει την απάτη.

«Πιστεύω ότι σύντομα θα φτάσουμε σε ένα σημείο που θα είναι αδύνατο να συμπεράνουμε αν ένα βίντεο είναι αυθεντικό» υποστηρίζει. «Μαζί με άλλους ερευνητές διεξάγουμε ήδη σοβαρές συζητήσεις για τη δεοντολογία και τις συνέπειες» προσθέτει. Δεν είναι ο μόνος που προβληματίζεται.

H Επιτροπή Πληροφοριών της αμερικανικής Βουλής των Αντιπροσώπων αφιέρωσε πρόσφατη συνεδρίασή της στις απειλές που συνεπάγεται η χρήση της συγκεκριμένης τεχνολογίας για τις προεδρικές εκλογές του 2020 στις ΗΠΑ. Η πολιτεία του Τέξας έχει ήδη απαγορεύσει παραποιημένα βίντεο «με στόχο να πλήξουν έναν υποψήφιο ή να επηρεάσουν εκλογικό αποτέλεσμα», ενώ και η Καλιφόρνια έχει απαγορεύσει τη χρήση της τεχνολογίας deepfake σε θέματα που άπτονται του πολιτικού διαλόγου.

Η τεχνολογία που επιτρέπει την αψεγάδιαστη σύνθεση ψηφιακών εικόνων με τη συνδρομή Τεχνητής Νοημοσύνης προσέλκυσε για πρώτη φορά τα φώτα της διεθνούς δημοσιότητας πριν από δύο χρόνια. Η δυνατότητα παραποίησης εικόνων μέσω ρετούς ή μοντάζ μπορεί να υπήρχε εδώ και πολλές δεκαετίες, αλλά μόνο πρόσφατα η τεχνολογία ωρίμασε αρκετά ώστε να παράγει τόσο αληθοφανή αποτελέσματα.

Ανταγωνιστικά δίκτυα και βαθιά μάθηση

To 2014, ένας Βρετανός μεταπτυχιακός φοιτητής σχεδίασε κάτι που ονόμασε «αναγεννητικό ανταγωνιστικό δίκτυο» ή αλλιώς GAN. Ήταν ένας τρόπος παραγωγής νέων δεδομένων από υφιστάμενα. Για παράδειγμα, το GAN μπορούσε να εξετάσει χιλιάδες φωτογραφίες κάποιου και να παράγει από αυτές μια νέα -και πλαστή- φωτογραφία που θα έμοιαζε μεν σε αρκετές, αλλά δεν θα αποτελούσε ακριβές αντίγραφο καμίας. Το GAN μπορούσε επίσης να χρησιμοποιηθεί για τη δημιουργία βίντεο αλλά και ηχητικών αρχείων. Ήταν ένα πολυεργαλείο.

Η τεχνολογία διαχύθηκε στο Διαδίκτυο και πολύ σύντομα, το φθινόπωρο του 2017, ένας χρήστης του κοινωνικού δικτύου Reddit με το ψευδώνυμο «deepfakes» άρχισε να κοινοποιεί τα πρώτα παραποιημένα βίντεο τα οποία εμφάνιζαν σταρ του Χόλιγουντ σε πορνογραφικές σκηνές. Άλλοι χρήστες με γνώσεις προγραμματισμού έσπευσαν στην πορεία να διορθώσουν τυχόν ατέλειες με τη βοήθεια της τεχνολογίας deep learning (ένας από τους κλάδους της Τεχνητής Νοημοσύνης) βελτιώνοντας σταδιακά το προϊόν.

Έναν χρόνο μετά, η ηθοποιός Σκάρλετ Γιόχανσον, που πρωταγωνιστούσε άθελά της σε πολλά από τα παραποιημένα βίντεο εξέφραζε την αγανάκτηση της για τον δρόμο που έχει πάρει το Ίντερνετ. «Είναι μια τεράστια σκουληκότρυπα που τρώει τον εαυτό της» σχολίασε. Δεν κινητοποιήθηκε ωστόσο για την απόσυρση των επίμαχων βίντεο αναγνωρίζοντας το μάταιο του εγχειρήματος. Δέκα πλαστά βίντεο θα έπαιρναν αμέσως τη θέση καθενός που θα αποσυρόταν.

Η τεχνολογική εταιρεία Deeptrace προσπάθησε να χαρτογραφήσει το φαινόμενο. Το 2018 μέτρησε 7.964 παραποιημένα βίντεο να κυκλοφορούν στις σκοτεινές και φωτεινές γωνιές του δικτύου. Τέσσερις μήνες πριν κλείσει η φετινή χρονιά τα ξαναμέτρησε και τα βρήκε 14.687 – μια αύξηση δηλαδή της τάξης του 84%. Στη συντριπτική πλειονότητά τους τα βίντεο έχουν πορνογραφικό περιεχόμενο. Δεν λείπουν όμως και οι περιπτώσεις όπου οι στόχοι είναι πολιτικοί.

Πορνογραφία, πολιτική και παράνοια

Στις αρχές του καλοκαιριού, τον γύρο του Διαδικτύου έκανε ένα βίντεο που εμφάνιζε την εκπρόσωπο της πλειοψηφίας των Δημοκρατικών στην αμερικανική Βουλή των Αντιπροσώπων Νάνσι Πελόζι να τραυλίζει σαν μεθυσμένη στη διάρκεια κάποιας ομιλίας της. Το βίντεο είχε δημιουργηθεί από έναν νεαρό Νεοϋορκέζο που αυτοπροσδιοριζόταν ως «σούπερ οπαδός» του Τραμπ.

Ανταμείβοντας τον πιστό οπαδό του, ο Αμερικανός Πρόεδρος αναμετέδωσε το παραποιημένο βίντεο στο Twitter προσθέτοντας μάλιστα τη λεζάντα «Η Πελόζι τραυλίζει σε συνέντευξη Τύπου». Το βίντεο ξεσκεπάστηκε ως πλαστό και τελικά αποσύρθηκε. Προηγουμένως, βέβαια, το είχαν δει εκατομμύρια χρήστες και είχε δεχτεί 100.000 εγκωμιαστικά σχόλια. Ο Αμερικανός Πρόεδρος δεν απέσυρε ποτέ το μήνυμα του.

Η έκταση που έχει πάρει το φαινόμενο των fake news απασχόλησε πρόσφατη έρευνα του Pew Research Center. Το κέντρο διαπίστωσε ότι επτά στους δέκα Αμερικανούς δηλώνουν πια ότι οι κατασκευασμένες ειδήσεις και πληροφορίες έχουν κλονίσει σοβαρά την εμπιστοσύνη τους στους θεσμούς. Το πιο ενδιαφέρον συμπέρασμα όμως ήταν πως σχεδόν οι μισοί (54%) υποστήριζαν πως η παραπληροφόρηση επηρεάζει ακόμη και την εμπιστοσύνη στον διπλανό τους.

Σε έναν τέτοιο κόσμο γενικευμένης παράνοιας κατανοεί κανείς ότι η πιο επικίνδυνη διάσταση της υπόθεσης δεν είναι η παραπληροφόρηση ούτε οι εξελιγμένες «μονταζιέρες». Μια εικόνα παύει να αξίζει όσο χίλιες λέξεις. Το ψέμα επιβεβαιώνεται με αποδείξεις και η αλήθεια που συλλαμβάνεται από τον φακό γίνεται πια δεκτή με δυσπιστία. Ο ερευνητής Αβίβ Οβάντια προειδοποιεί για την «απάθεια απέναντι στην πραγματικότητα». Η διαρκής παραπληροφόρηση αναγκάζει τους ανθρώπους να αμφιβάλλουν για τα πάντα.

Ο μεγαλύτερος κίνδυνος δεν είναι τελικά η χειραγώγηση και η πιθανότητα επηρεασμού εκλογικών αποτελεσμάτων μέσω πλαστών βίντεο, αλλά η εδραίωση της αντίληψης ότι όλα είναι ψέματα και όλοι είναι ψεύτες. Μιας αντίληψης που με τη σειρά της παράγει περισσότερη απάθεια, περισσότερα εντυπωσιακά, εύπεπτα fake news και, αναπόφευκτα, περισσότερους Τραμπ.

Μιχάλης Τρίκκας

Πηγή: Η Αυγή